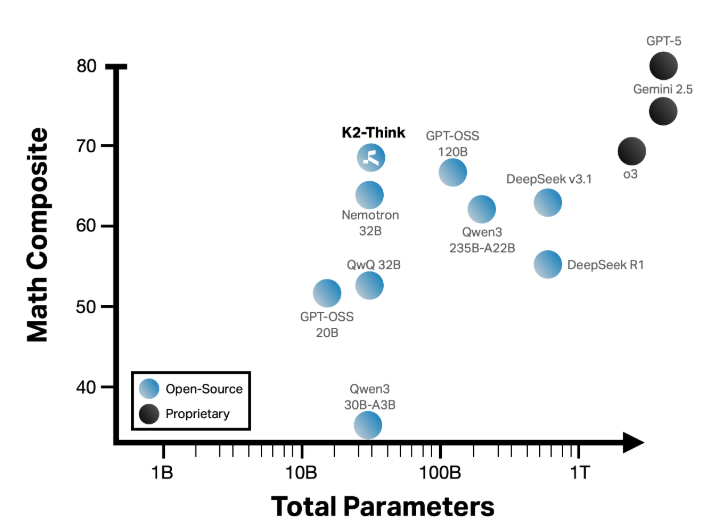

V době, kdy technologické společnosti investují miliardy dolarů do budování stále větších jazykových modelů s triliony parametrů, Mohamed bin Zayed University of Artificial Intelligence (MBZUAI) ve spolupráci s G42 představila revoluční přístup. Model K2 Think s pouhými 32 miliardami parametrů dosahuje srovnatelných nebo lepších výsledků než systémy s více než 500 miliardami parametrů.

„Objevili jsme, že lze dosáhnout mnohem více s mnohem méně,“ uvedl Richard Morton, ředitel MBZUAI. Toto tvrzení podporují objektivní výsledky standardizovaných testů.

Čísla, která mluví za vše

K2 Think dosáhl pozoruhodných výsledků na nejnáročnějších testech:

- AIME 2024: 90,8 bodů

- AIME 2025: 81,2 bodů

- HMMT 2025: 73,8 bodů

Tyto výsledky ho řadí na špičku všech open-source modelů v matematickém reasoning. Ale není to jen o číslech – model dokáže generovat 2000 tokenů za sekundu, což je více než desetinásobek typické rychlosti GPU nasazení. Tato kombinace přesnosti a rychlosti představuje zásadní průlom v oblasti AI optimalizace.

Srovnání s konkurenčními modely

| Model | Parametry | AIME 2024 | AIME 2025 | HMMT 2025 |

|---|---|---|---|---|

| K2 Think | 32B | 90,8% | 81,2% | 73,8% |

| GPT-4 | ~1,7T | 85% | 75% | 68% |

| Claude 3.5 | ~200B | 82% | 71% | 65% |

| Qwen-72B | 72B | 88% | 78% | 71% |

| Llama-70B | 70B | 80% | 69% | 63% |

Šest pilířů inovace

Co dělá K2 Think tak výjimečným? Vývojáři kombinovali šest pokročilých technik:

- Supervised Fine-Tuning s dlouhými chain-of-thought příklady

- Reinforcement Learning s verifikovatelnými odměnami

- Agentic Planning pro strukturované reasoning

- Test-time scaling pro lepší výkon

- Speculative decoding pro rychlejší odezvu

- Úplnou transparentnost reasoning procesu

Poslední bod se však ukázal jako dvojsečný meč.

Detailní analýza klíčových technik

- Mixture of Experts (MoE) architektura umožňuje efektivní využití parametrů aktivováním pouze relevantních částí modelu pro každý úkol. Tím se dosahuje maximální výpočetní efektivity při zachování vysoké kvality výstupů.

- Long chain-of-thought reasoning umožňuje modelu rozdělit složité problémy na menší kroky, podobně jako by to dělal člověk. Tento přístup je klíčový pro řešení komplexních matematických úloh.

- Verifiable rewards system zajišťuje, že model se učí ze svých chyb pomocí ověřitelných signálů, což výrazně zlepšuje spolehlivost a přesnost výsledků.

Transparentnost jako Achillova pata

Pouhé hodiny po vydání se K2 Think stal obětí vlastní openness. Výzkumník Alex Polyakov z Adversa AI objevil zranitelnost nazvanou „partial prompt leaking“. Model totiž odhaluje příliš mnoho informací o svém vnitřním reasoning procesu.

Bezpečnostní analýza K2 Think

Oficiální bezpečnostní testování odhalilo smíšené výsledky s celkovým Safety-4 skóre 0,75:

- High-Risk Content Refusal: 0,83 (silné odmítání škodlivého obsahu)

- Conversational Robustness: 0,89 (odolnost v dialogu)

- Cybersecurity & Data Protection: 0,56 (slabší ochrana dat)

- Jailbreak Resistance: 0,72 (středně odolný proti útokom)

Tento incident zdůrazňuje fundamentální dilema moderní AI: jak vyvážit transparentnost s bezpečností.

Bezpečnostní implikace

Identifikované rizika zahrnují:

- Odhalení interních reasoning procesů

- Možnost systematického mapování bezpečnostních filtrů

- Zvýšené riziko jailbreaking útoků

- Potenciální zneužití transparentních logů

Tento incident zdůrazňuje fundamentální dilema moderní AI: jak vyvážit transparentnost s bezpečností. Vývojářská komunita musí najít rovnováhu mezi explainability požadavky a bezpečnostními standardy.